ハルシネーションには要注意

ChatGPTを使う際に、特に注意してほしいのが「ハルシネーション」だ。これは、一見もっともらしい回答に思えるが、実は「事実とは異なる内容」だったり、「文脈と無関係な内容」だったりと誤った情報であることを指す。

ハルシネーションはChatGPTに限らず、生成AI全体の問題で、学習データが古い、または不足している、AIが正しくデータを把握できていない、前後の文脈だけで回答を生成しているなどの要因で発生する。

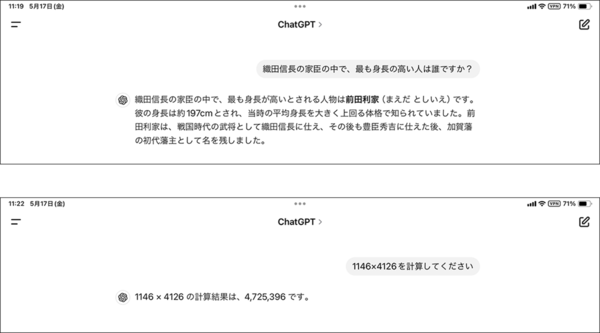

例えば、「織田信長の家臣の中で、最も身長の高い人は誰ですか?」と質問したところ、「前田利家で197cm」という回答があったが、これは正確な情報ではない。また、計算についても苦手で、「1146×4126」という掛け算の計算結果を「4,725,396」と回答した。正しい回答は「4,728,396」だ。

このようにChatGPT(ほかの生成AIも同様だが)は、意外にも嘘をつくことがある。そして困るのは、その回答が自信満々に見える点だ。あまりに自然に回答してくるので、疑うにも判断に迷うことがある。

今の技術ではハルシネーションを完全に防ぐことは難しい。しかし、質問を明確かつ簡潔にするとハルシネーションの発生率を減らせる。そのため、プロンプトには細心の注意を払うようにしよう。また、ChatGPTからの回答はうのみにせず、必ず自分の手でファクトチェック(事実確認)することが重要だ。

業務で使う場合に変更しておくべき設定がある

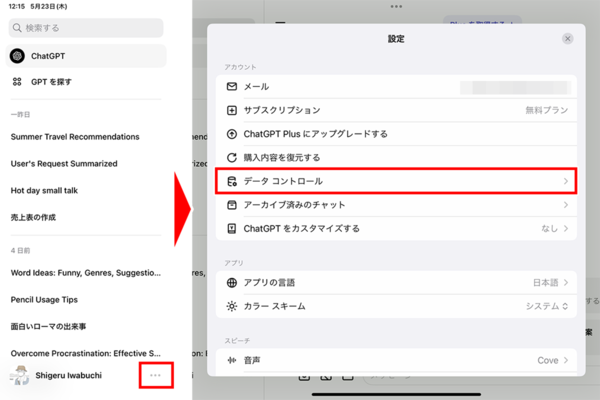

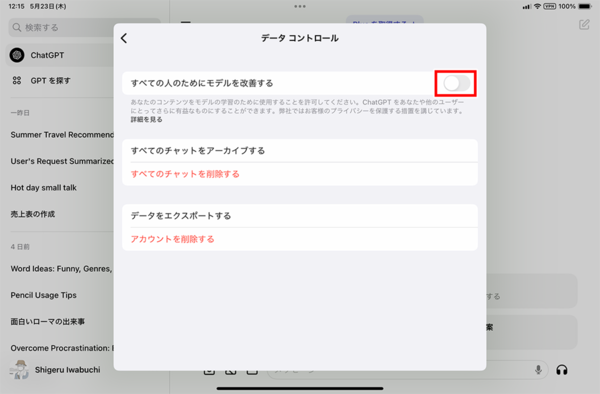

ChatGPTを業務で使う場合は、データの取り扱いに注意が必要だ。「ChatGPT」アプリのデフォルト設定では、会話の履歴が言語モデル(LLM)の学習に使われる。つまり、仕事の情報などを入力すると、その内容が外部へ漏えいするおそれがあるのだ。実際、2023年には、入力した情報が漏えいして問題になったことがある。企業によっては機密情報保護に反する場合もあるので、利用する際は絶対に注意すべきだ。

「ChatGPT」アプリでは、会話の履歴を学習に使わせないように設定できる。もし、業務の内容を入力することがある場合は、この設定は必ずオフにしておこう。なお、企業によってはChatGPT自体の使用を禁止しているところもあるので、業務目的で使う場合は、必ず事前に使用の可否を確認してから利用してほしい。

今回は、iPadでの「ChatGPT」アプリの基本的な使い方について解説してきた。ChatGPTは、仕事のあり方を根本から覆す力を持ったものなので、ぜひ普段の仕事や勉強に活用していただきたい。