スマホを出さずにナビもAI検索もこなす

プロトタイプグラス

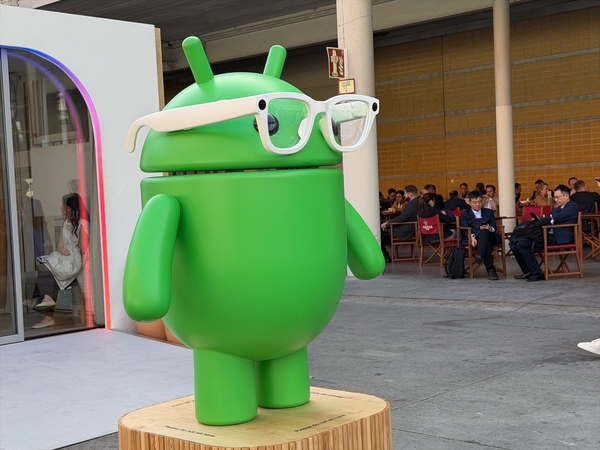

MWC Barcelona 2026のGoogleブース「Android Avenue」で、Android XRを搭載したスマートグラスのプロトタイプを体験した。Googleがこのグラスを一般来場者に公開するのは今回が初めて。

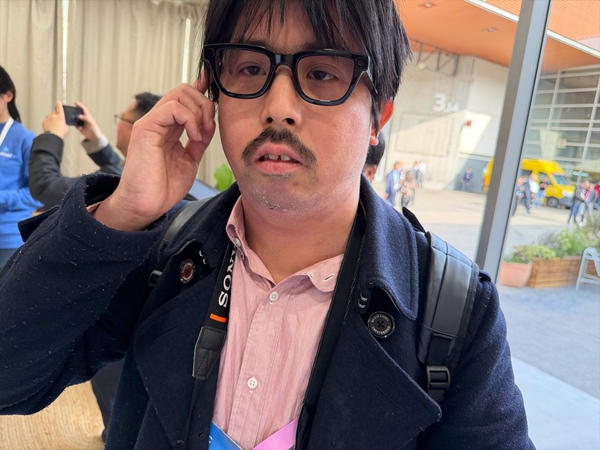

外観はクラシックなスクエア型の黒縁フレームで、普通のメガネとほとんど変わらない。右レンズにカラー対応の導光板ディスプレイを内蔵し、右テンプルの外側にはタッチパッドを備える。カメラ、マイク、スピーカーも組み込まれており、処理はペアリングしたAndroidスマートフォンが担う。重さは数値の開示こそなかったが、かけた瞬間にずしりとした感覚はなく、普段使いのメガネに近い装着感だった。度付きレンズにはクリップオンで対応する。

デモは約10〜15分の構成で、4つの機能を順に試した。最初はマルチモーダル検索だ。テンプルのタッチパッドを2秒間長押しするとGeminiが起動する。目の前に置かれたレコードのジャケットに視線を向け「このアルバムの曲を再生して」と話しかけると、数秒後にスピーカーから音楽が流れ始めた。カメラが捉えた画像をGeminiが認識し、YouTube Musicと連携して楽曲を再生する仕組みだ。

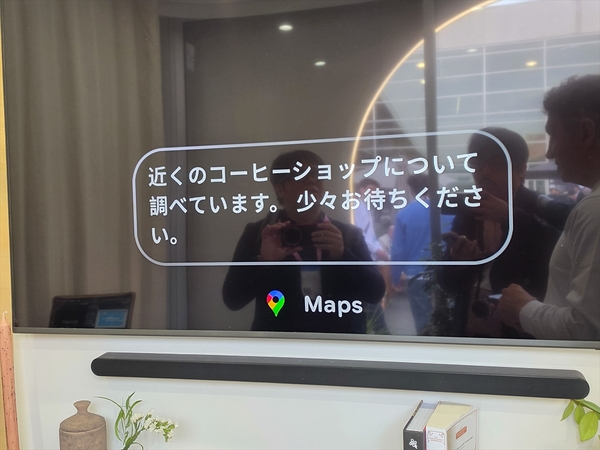

次に試したのがGoogleマップのナビゲーションだ。正面を向いていると、レンズの右上あたりにターンバイターンの案内カードがすっと表示される。頭を下に傾けると地図が現れ、タッチパッドを前後にスワイプすると地図の拡大・縮小もできた。スマホを取り出さなくても目的地まで歩ける。案内カードと地図の切り替わりはなめらかで、視線移動に合わせた表示の出し入れは自然だった。

3つ目はAI画像生成の「Nano Banana」だ。「写真を撮って」と音声で指示すると、カメラが起動してプレビューがレンズ内に表示される。続けて「これをアニメ風にして」と日本語で指示を出すと、画像がクラウドで加工され、数秒後にレンズ上でプレビューできた。サイバーパンクやクリスマスなど、テーマは自由に指定できるという。

最後はリアルタイム翻訳だ。デモ担当者がスペイン語で「Hola,como estas」と話しかけると、数秒もしないうちに日本語の音声がスピーカーから流れた。続けてペルシャ語でも試したが、こちらもほぼ即座に翻訳される。対応言語は設定で切り替えられる。海外出張や旅行で、目の前の相手が何を言っているかがメガネ越しにわかる体験は、スマホの翻訳アプリとは没入感が違った。

現時点ではプロトタイプのため、デバイスの近接撮影は制限されていた。製品版の仕様や価格は未発表だ。Googleは2026年中にディスプレイなしのオーディオ専用モデルを先行投入し、今回のようなディスプレイ搭載モデルも、その後に続く計画だと複数の海外メディアが報じている。

10年前のGoogle Glassは時代を先取りしすぎた。Geminiとの統合で実用性がぐっと上がった今回のプロトタイプは、そのリベンジといえる。競合のMeta Ray-Ban Display Glassesは799ドル(約12万6000円)で発売済みだが、Googleはナビゲーションや画像生成まで含めたAI体験とアプリのエコシステムで差別化を図る構えだ。